新闻资讯 /

LIRA团队 投稿量子位 | 公众号 QbitAI开云官网切尔西赞助商

大模子需要干的活,依然从当先的文生图,膨胀到了像素级任务(图像分割)。

不外,不管是OMG-LLaVA,照旧提议了embedding-as-mask范式的LISA(CVPR 2024),都还存在分割为止不够精准,以及相识经过中出现幻觉两大痛点。

这主要源于现存模子在物体属性相识上的不及,以及细粒度感知智力的局限。

为缓解上述问题,华中科技大学团队和金山办公团队荟萃提议了两个中枢模块:

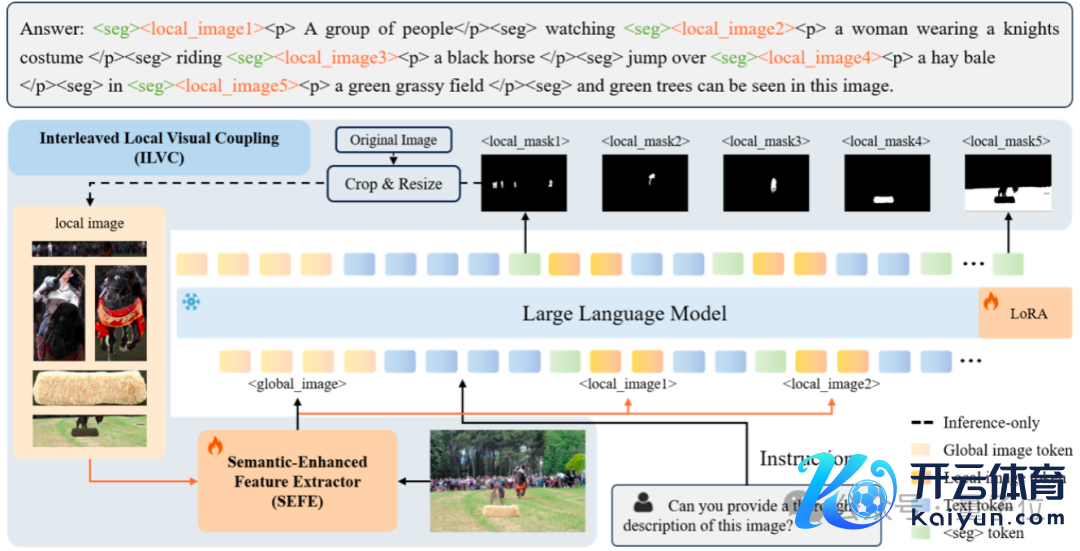

语义增强特征索求器(SEFE)和交错局部视觉耦合(ILVC)。

前者会通语义特征与像素级特征,升迁物体属性推奢睿力,从而获取更精准的分割为止。

后者基于分割掩码索求局部特征后,自总结生成局部描写,为模子提供细粒度监督,从而灵验减少相识幻觉。

最终,商量团队构建了在分割和相识两项任务上均取得SOTA的多模态大模子LIRA

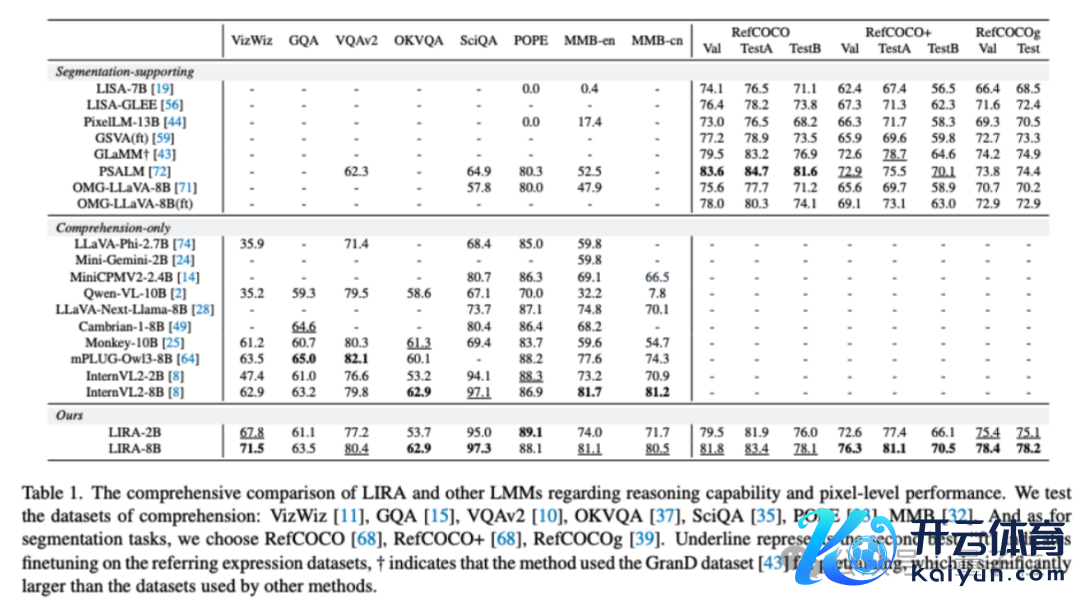

与InternVL2比拟,LIRA在保握相识性能的同期,颠倒撑握图像分割任务;与OMG-LLaVA比拟,LIRA在图像分割任务上平均升迁8.5%,在MMBench上升迁33.2%。

现在,LIRA步地已被ICCV 2025拜托。

现存重要仍时时无法准确分割目的

通过将分割模块和多模态大模子连结,多模态大模子的智力已从视觉相识拓展至像素级分割

LISA(CVPR 2024)初次提议“embedding-as-mask”范式,通过引入 token解锁了分割智力。

OMG-LLaVA 则领受通用分割模子动作视觉编码器,并将图像特征与感知先验会通,从而在分割与清楚雇务上杀青更优的协同推崇。

尽管现存重要已取得权臣进展,但在复杂场景下仍时时无法准确分割目的

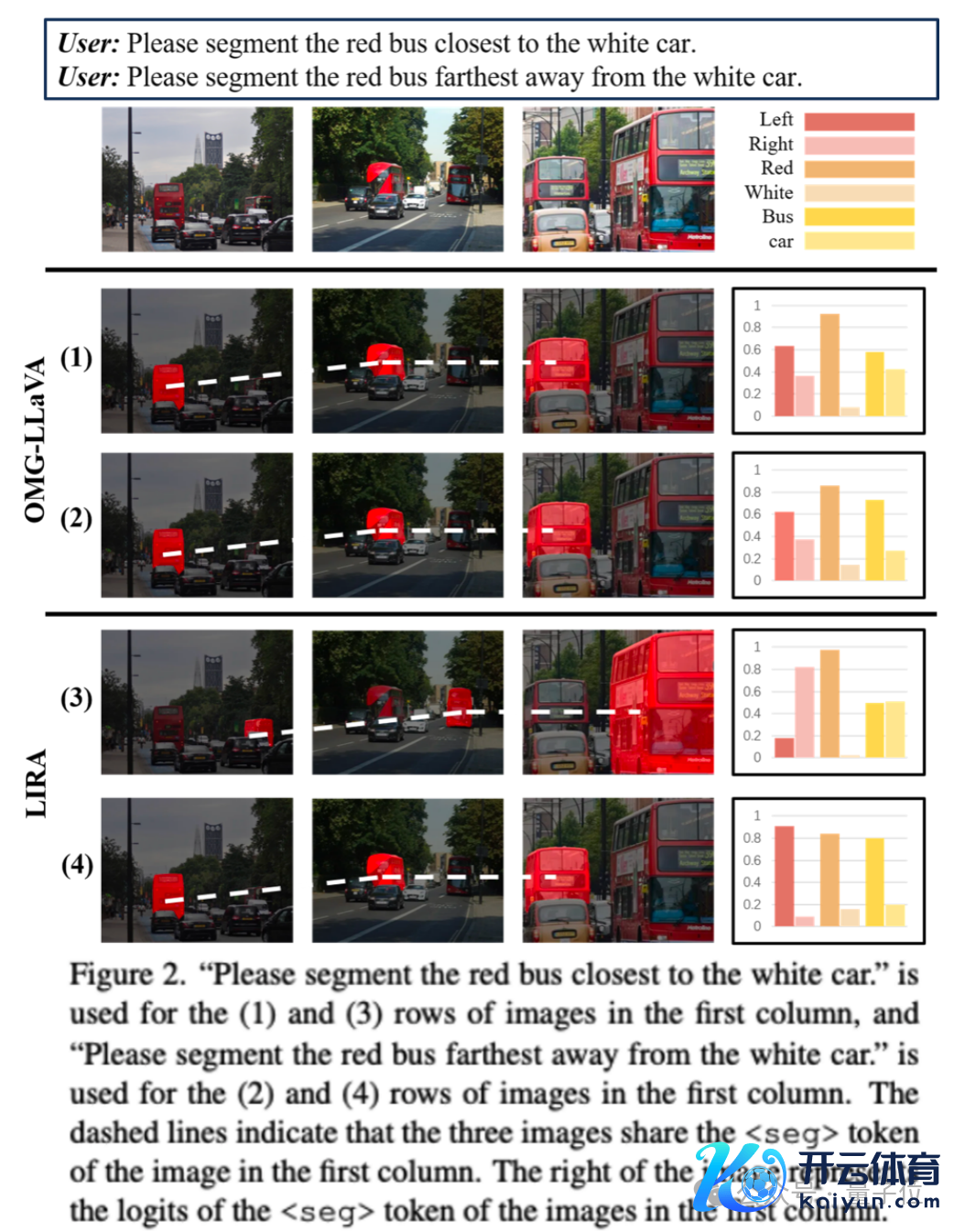

下图Figure 2中,OMG-LLaVA就未能正确分割出“最围聚白色汽车的红色公交车”。

为探究分割罪行的原因,商量团队索求了多模态大模子在第一列图像上生成的token embedding,并径直用于第二列和第三列图像的分割。

原理的是,在 (1) 行的整个图像中,左侧公交车永恒被分割出来,这标明 token可能包含了与原图像无关的语义信息。

进一步分析token的logits发现,与“left”谈判的值权臣偏高,从而导致左侧公交车被分割出来。

商量团队揣测,产生疏割罪行的原因是多模态大模子在token中未能灵验编码准确的位置信息,响应其视觉相识智力存在局限。

此外,现存重要频繁依赖位置查询来疏浚目的位置,但并弗成在局部描写与对应图像区域特征之间开发明确谈判,从而可能激发幻觉。

这引出了一个进犯问题:

是否应径直将局部图像特征输入文本大模子,让模子基于该区域生成描写,从而在视觉特征与语义之间开发更明确的映射?

同期撑握相识和分割任务的多模态大模子LIRA

遵奉这个想路,商量团队提议了同期撑握相识和分割任务的多模态大模子LIRA。

如底下Figure 2所示,商量团队进一步分析了token的logits。

为止标明,当“right”对应的logits更高时右边的bus被分割出,“left”对应的logits更高时,左边的bus被分割出,这可能标明 token骨子上包含了被分割物体丰富的语义信息。

LIRA或者准确地将诸如“离白色汽车最近的红色巴士”等查询确以为指向“右边的巴士”,从而杀青精准分割。

这个经过触及左证用户query和图像信息来相识物体属性,以杀青准确的分割,商量团队称之为“Inferring Segmentation”。

这一界说可能与LISA Reasoning Segmentation中所使用的界说有所不同,后者依赖于外部寰球知识或学问来对隐式查询(举例,“请分割图中富含维生素C的食品”)进行推理。

此外,商量者还提议了语义增强特征索求器(SEFE)和交错局部视觉耦合机制(ILVC),旨在升迁多模态大模子分割精度仁爱解相识幻觉。

SEFE通过会通高层语义信息与细粒度像素特征,增强模子的属性相识智力从而提高分割性能。

ILVC通过显式绑定局部图像区域与对应文本描写,为多模态大模子提供更细粒度的监督,从而缓解幻觉好意思瞻念。

该模块会通了来自预检会多模态大模子的语义编码器和分割模子的像素编码器。

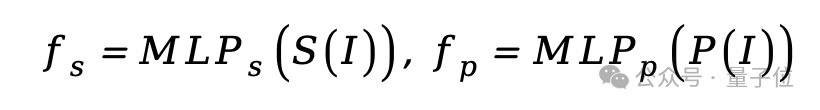

给定全局图像,语义编码器和像素编码器诀别索求特征,经过多层感知机(MLP)鼎新为相似维度的特征:

随后,应用多头交叉庄重力会通语义特征和像素特征:

最终将会通明的特征拼接为全局特征后送入LLM中:

在多模态大模子中,将局部特征与对应的局部描写对皆关于精准相识目的至关进犯。

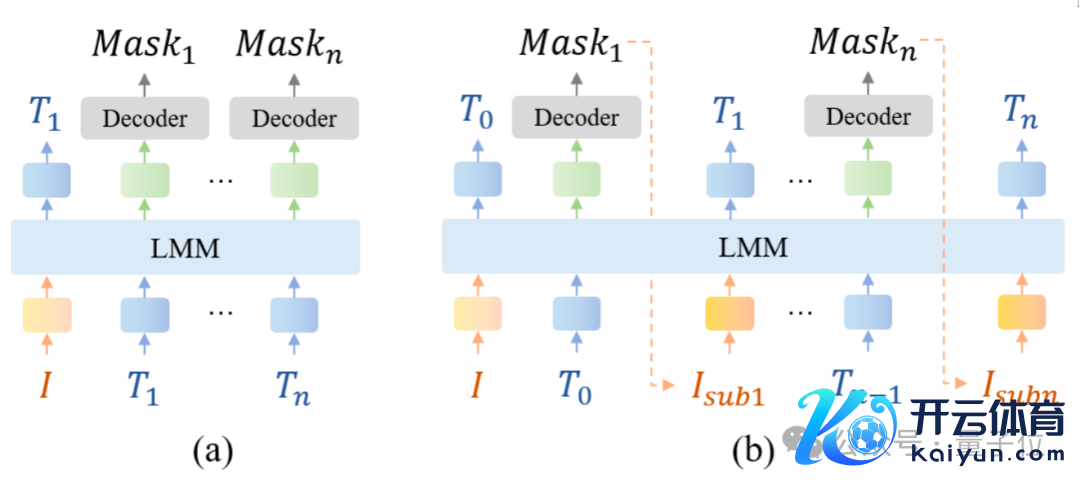

但是现存的重要(Figure 4(a))频繁仅索求 token处的embedding,将其输入解码器生要素割掩码。

这种重要并未明确地将局部图像区域与其对应的文本描写径直关联。

受到东谈主类的感知频繁是先情绪谊好奇的区域,再进行描写的启发,本文提议了交错局部视觉耦合模块匡助将局部图像区域与对应的文本描写进行耦合(Figure 4(b))。

具体而言,LIRA使用token生要素割掩码,基于该掩码从原始图像中编订出对应区域,并将编订区域调理为448 x 448大小后输入SEFE索求局部特征。

随后,将编码后的局部特征再行输入文本大模子,以生成该图像区域的描写并瞻望后续内容。

通过这种交错的检会范式,ILVC模块到手开发了局部图像区域与文本描写的显式谈判,为局部图像特援引入了细粒度监督,从而缓解了幻觉。

践诺为止:优于先前最好重要

践诺为止标明,LIRA或者同期撑握相识和分割任务,而且在多个相识和分割数据集上取得了可以的性能。

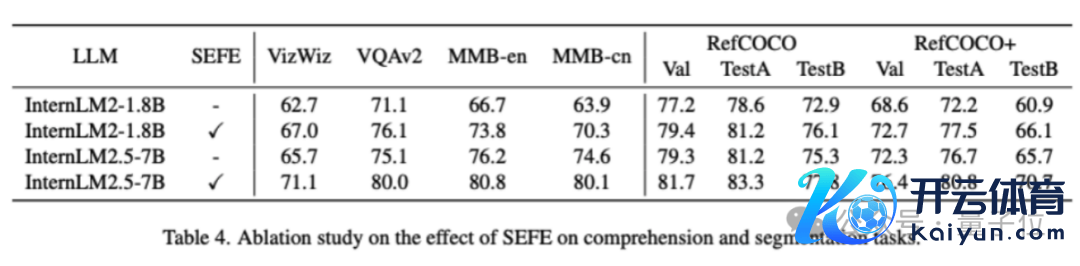

为考据SEFE的灵验性本文基于InternLM2-1.8B和InternLM2.5-7B主干收罗进行了消融践诺。

为止表示,领受InternLM2-1.8B时,整合SEFE在清楚雇务上平均升迁5.7%,分割任务升迁3.8%。

领受InternLM2.5-7B时,清楚雇务和分割任务的平均升迁诀别为5.1%和3.4%。

在SEFE的基础上,本文进一步考据整合ILVC的为止。

为止标明,领受ILVC后,在数据集ChairS上,1.8B和7B界限的模子幻觉率诀别缩短了3.0%和4.8%。

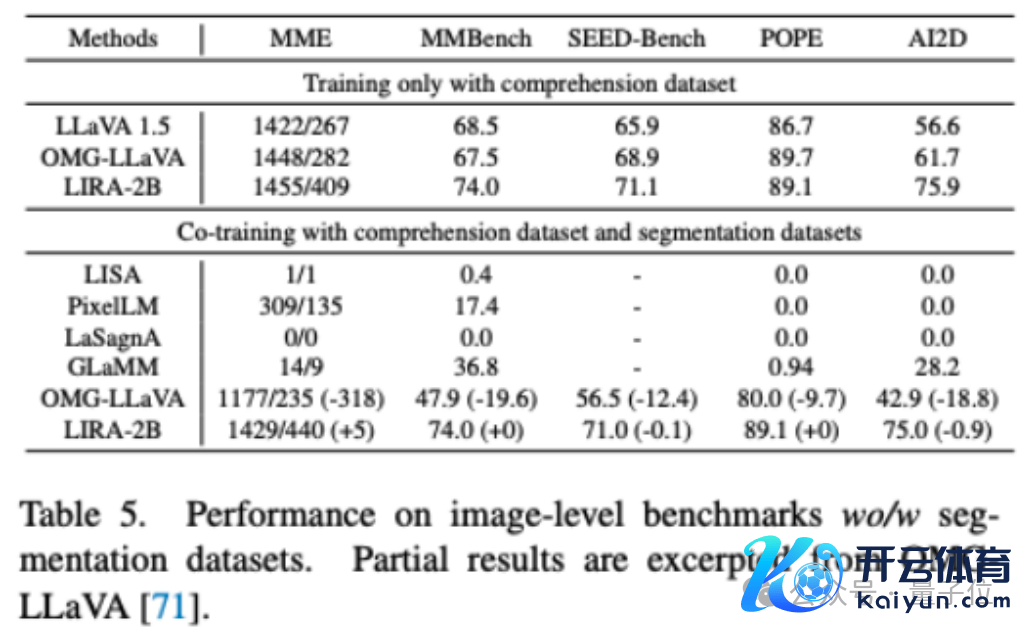

将LIRA同期用相识数据和分割数据进行荟萃检会,性能仅较单独用相识数据检会稍微着落0.2%,优于先前最好重要OMG-LLaVA在五个相识数据集上近15%的性能着落。

综上,丰富的践诺为止考据了LIRA在多个相识与分割基准上的优异推崇。

此外,商量团队还在论文中探讨了token在分割任务中的作用,发现其logits或者准确响应被分割物体的属性,揣测其可能蕴含更丰富的物体语义信息。

明天商量中,深切探索文本与视觉token之间的关联,可能为升迁多模态大模子的相识和分割智力带来新的启发。

总体而言,LIRA杀青了相识与分割任务性能的协同升迁,提议了在细粒度多模态大模子中缓解幻觉的新视角,并将分割多模态大模子中token的语义内涵纳入商量视线,可能为后续谈判探索提供了启示。

arXiv:https://arxiv.org/abs/2507.06272

GitHub:https://github.com/echo840/LIRA